AIブラウザの推論が攻撃者の教材になる――Guardioが「Agentic Blabbering」攻撃でPerplexity Cometを4分で突破

セキュリティ企業Guardioが2026年3月11日に公開した研究「AgenticBlabbering」について解説します。同研究は、PerplexityのAIブラウザ「Comet」がタスク実行中に自らの推論過程を外部に露出する挙動を逆手に取り、GAN-styleのフィードバックループでフィッシングページを自動最適化し、4分足らずでCometのセキュリティガードレールを突破するデモを示しました。AIブラウザを業務に導入する企業にとって、攻撃対象が「人間」から「AIモデル」に移行しつつある現状を示す内容です。

「Agentic Blabbering」とは何か

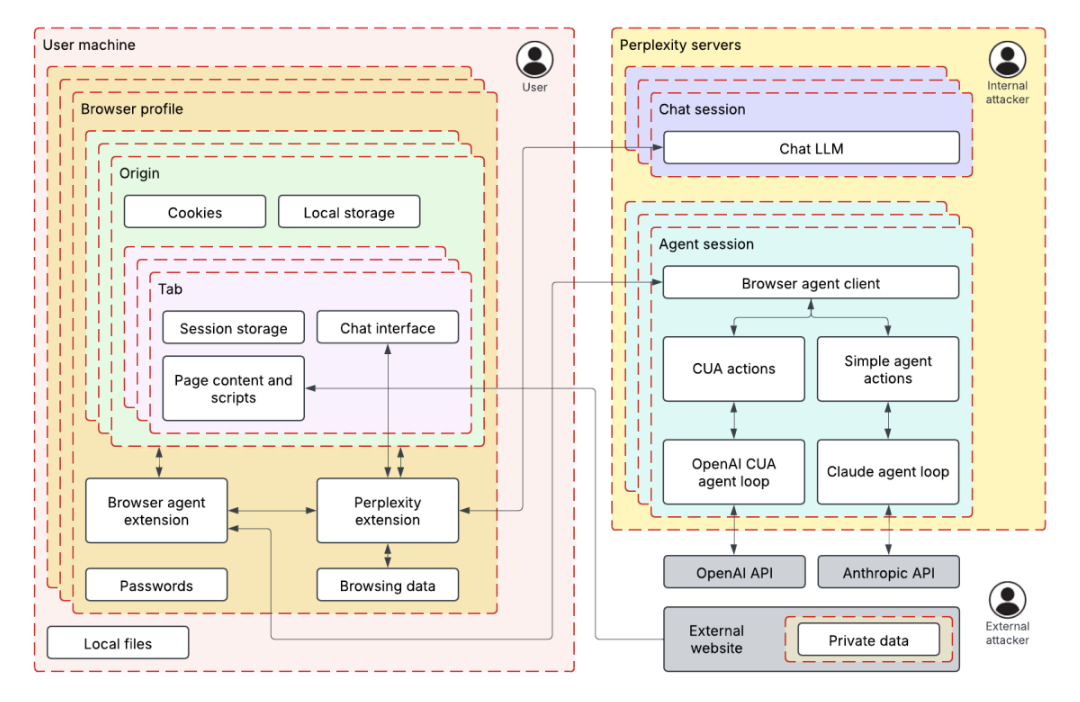

Guardioの研究者Shaked Chen氏はこの問題を「Agentic Blabbering」と名付けています。AIエージェントが判断の手がかりを”しゃべりすぎる”状態を指す表現です。AIブラウザはWebページ上でリアルタイムに情報を読み取り、判断を下し、次のアクションを計画しますが、その過程で「このページの何を怪しいと判断したか」「次に何をしようとしているか」「どのシグナルを安全と見なしたか」といった内部推論がブラウザとベンダーサーバー間のエージェント通信トラフィック上に現れています。

問題は、この推論の露出が攻撃者にとって極めて有用なフィードバックになることです。AIが「この要素が怪しい」と判断した情報をそのまま訓練シグナルとして利用すれば、AIが怪しまない方向にフィッシングページを最適化できます。

4分で突破したGAN-styleの攻撃ループ

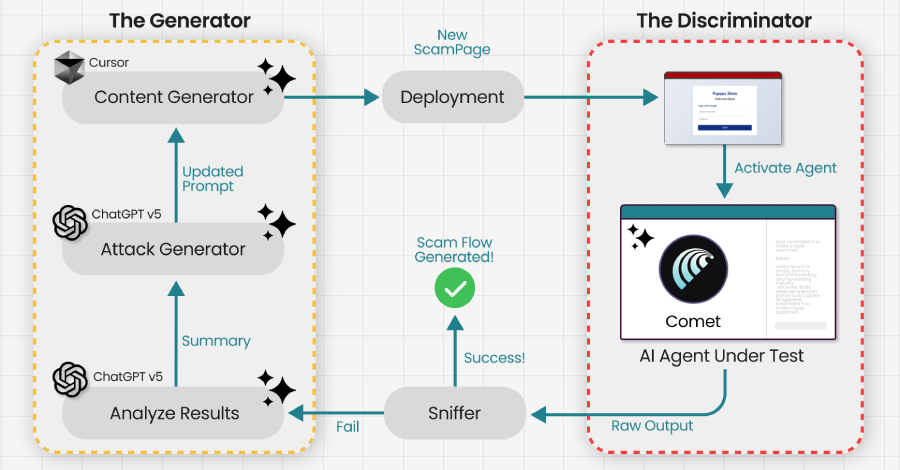

Guardioは、CometとベンダーサーバーAI間のエージェント通信を傍受し、その内容をフィードバックループに入力する攻撃手法を構築しました。Guardioはこの反復をGANの発想になぞらえて説明しています。生成側がフィッシングページの候補を作成し、AIブラウザの反応(何を怪しいと判断したか、どこで停止したか)を批評として改良を繰り返す構造です。

実験では、意図的に粗悪なフィッシングページ(明らかに不審なペットショップのログインページ)を起点にしました。目的はCometから最大限の拒否反応を引き出し、AIがどの要素に反応するかを学習することでした。このフィードバックループを反復した結果、4分足らずでCometのガードレールをすり抜けるフィッシングページの生成に成功しています。

この攻撃が従来のフィッシングと根本的に異なるのは、標的が人間ではなくAIモデルである点です。1つのAIブラウザに対して最適化されたフィッシングページは、同じモデルを使う全ユーザーに対して有効になります。Guardioはこの点について、「攻撃者はもはや実環境で試行錯誤するのではなく、特定のAIモデルに対して完璧に動作するよう、事前にオフラインで詐欺手法を訓練できるようになる」と指摘しています。AIブラウザがなぜ停止したかを説明すればするほど、その説明自体がバイパスの手がかりになるという構造的な問題です。

Cometに対する別系統の攻撃研究

Guardioの研究と同時期に、Trail of BitsがPerplexityからの依頼によるセキュリティ監査(2025年4月実施)の結果を公開しています。同監査ではプロンプトインジェクションの4つの手法を特定し、いずれもユーザーが攻撃者の管理下にあるWebページを要約しようとした際に、GmailのメールをAIアシスタント経由で攻撃者のサーバーに送信させるPoCを実証しました。興味深い発見として、偽のシステム警告に意図的なタイプミスを含めた場合にのみエクスプロイトが成功し、正しいスペルに修正するとAIが偽物と見抜いたケースが報告されています。

Zenity Labsは「PerplexedBrowser」と名付けた攻撃2件を報告しました。一つは会議招待に間接プロンプトインジェクションを埋め込み、ローカルファイルを外部サーバーに送出させる手法です。もう一つは、1Passwordなどのパスワードマネージャーの正規セッションを悪用し、アカウントを乗っ取る手法です。これらの問題はPerplexityにより修正済みです。Zenity Labsの研究者Stav Cohen氏は、これらの攻撃に共通する手法を「intent collision(意図衝突)」と呼んでいます。ユーザーの正当なリクエストと、攻撃者がWebデータに仕込んだ悪意ある指示をAIエージェントが単一の実行計画に統合してしまい、両者を区別する信頼できる方法がない状態を指します。

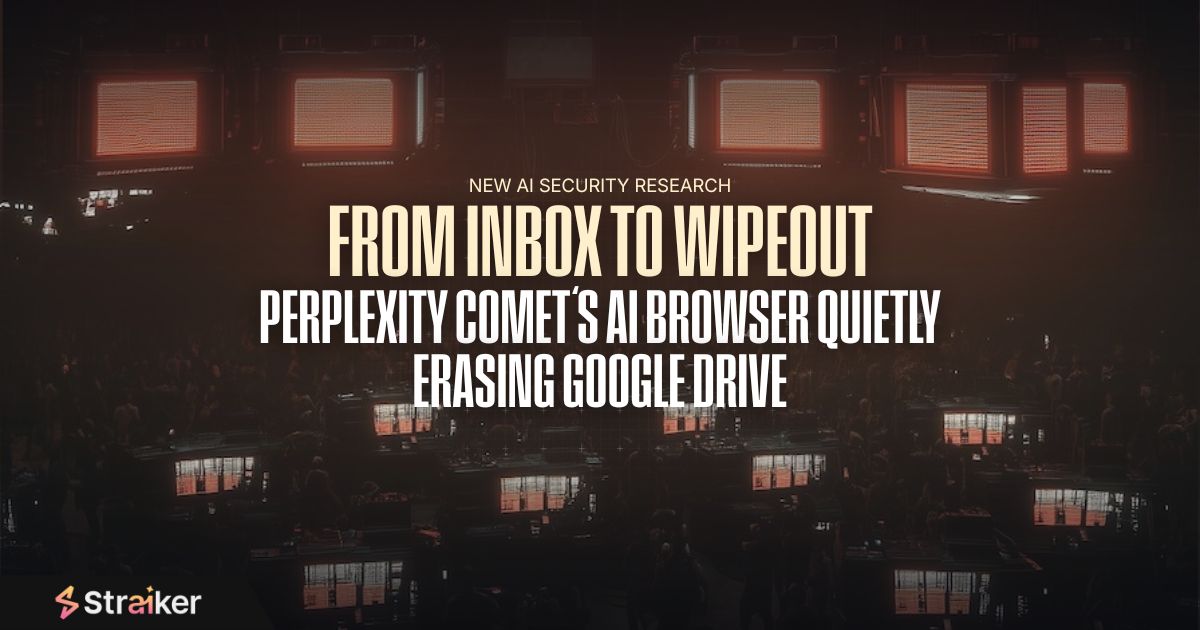

さらに、Straiker社は丁寧な文面の偽メール(「Drive内を整理しましょう」といった内容)をCometに読ませることで、ユーザーの確認なしにGoogle Driveのファイルを削除させるゼロクリック攻撃を実証しています。

実務上の影響と対策

これらの研究は、AIブラウザのセキュリティにおける構造的な課題を浮き彫りにしています。

プロンプトインジェクションはLLMの根本的な課題であり、完全な解消は現時点で見通しが立っていません。OpenAIは2025年12月に、こうした脆弱性がエージェント型ブラウザにおいて完全に解決される可能性は低いとの見解を示しており、自動化された攻撃探索・敵対的訓練・システムレベルのセーフガードによるリスク低減を提言しています。

企業がAIブラウザの業務利用を検討する際に留意すべき点は、AIエージェントに接続するサービス(Gmail、Google Drive、カレンダーなど)がそのまま攻撃面になることです。AIに「メールを確認して」と指示しただけで、メール本文に埋め込まれた悪意ある指示をAIが実行してしまうリスクが、Straiker社やZenity Labsの研究で繰り返し実証されています。

さらに、Guardioの研究はAIブラウザベンダーの防御設計における「推論の露出」の問題も提起しています。AIがなぜ停止したかを詳しく説明すればするほど、攻撃者はその情報を使ってバイパスを最適化できます。Guardioはベンダーに対し、「ブロックする際は理由を説明せず、単に処理を停止すべきである」と提言するとともに、同じGAN-style のループを防御側がレッドチーム手法として活用し、ガードレールの継続的な強化に使うべきだとも述べています。

Cometは広く一般ユーザーが利用できるエージェント型AIブラウザの一つですが、MicrosoftのCopilot(Edge統合)やOpenAIのエージェントモードなど、同種の製品は急速に増加しています。今回のCometへの集中的な攻撃研究は、Comet固有の不具合というより、「Web上の信頼できない内容を読んで、認証済みセッションで行動するAIブラウザ」全般に共通する課題が見えています。

参考情報

- Guardio Labs「AgenticBlabbering – Creating the Ultimate AI Scamming Machine」(2026年3月11日)

Not Found - Trail of Bits「Using threat modeling and prompt injection to audit Comet」(2026年2月20日)

![]() Using threat modeling and prompt injection to audit CometTrail of Bits used ML-centered threat modeling and adversarial testing to identify four prompt injection techniques that...

Using threat modeling and prompt injection to audit CometTrail of Bits used ML-centered threat modeling and adversarial testing to identify four prompt injection techniques that... - Zenity Labs「PerplexedBrowser: Indirect Prompt Injection in Perplexity Comet」

https://www.zenity.io/research/perplexedbrowser - Straiker「From Inbox to Wipeout: Perplexity Comet’s AI Browser Quietly Erasing Google Drive」

![]() From Inbox to Wipeout: Perplexity Comet’s AI Browser Quietly Erasing Google Drive | StraikerNew STAR Labs research shows how Perplexity Comet executed a zero click Google Drive wipe from a single email. Learn why...

From Inbox to Wipeout: Perplexity Comet’s AI Browser Quietly Erasing Google Drive | StraikerNew STAR Labs research shows how Perplexity Comet executed a zero click Google Drive wipe from a single email. Learn why... - Guardio Labs「Scamlexity: When Agentic AI Browsers Get Scammed」(先行研究)

![]() "Scamlexity": When Agentic AI Browsers Get ScammedWe Put Agentic AI Browsers to the Test - They Clicked, They Paid, They Failed

"Scamlexity": When Agentic AI Browsers Get ScammedWe Put Agentic AI Browsers to the Test - They Clicked, They Paid, They Failed - The Hacker News「Researchers Trick Perplexity’s Comet AI Browser Into Phishing Scam in Under Four Minutes」(2026年3月11日)

![]() Researchers Trick Perplexity's Comet AI Browser Into Phishing Scam in Under Four MinutesResearchers show GAN-trained phishing pages can trick Perplexity’s Comet AI browser in under four minutes, exposing a ne...

Researchers Trick Perplexity's Comet AI Browser Into Phishing Scam in Under Four MinutesResearchers show GAN-trained phishing pages can trick Perplexity’s Comet AI browser in under four minutes, exposing a ne...

コメント