概要

本稿では、OpenAIが公開したAIセキュリティエージェント「Codex Security」の仕組みと初期実績を整理します。あわせて、AnthropicのClaude Code Securityと比較しながら、実務上の意味を考えます。

何が起きたか

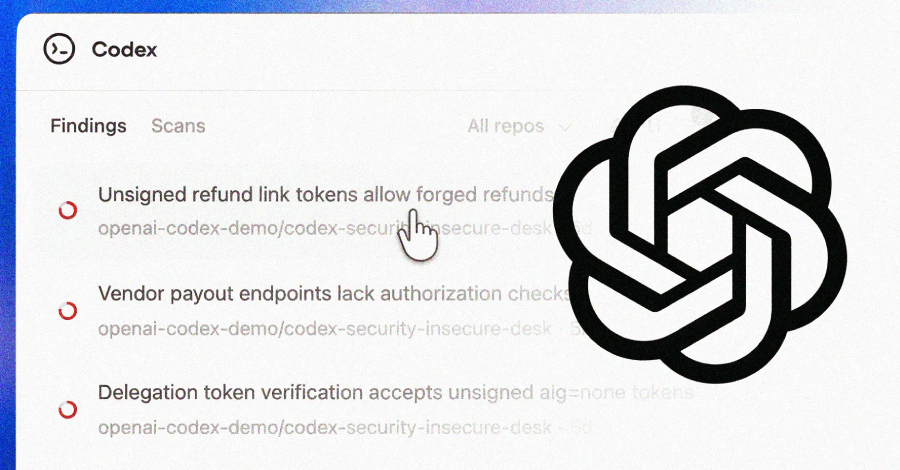

OpenAIは米国時間2026年3月6日(日本時間3月7日ごろ)、AIによるコードセキュリティスキャンツール「Codex Security」をリサーチプレビューとして公開しました。ChatGPT Pro、Enterprise、Business、Edu向けにCodex Webで順次提供され、最初の1か月は無料で利用できます。

Codex Securityは、2025年10月にプライベートベータとして公開された「Aardvark」の発展版です。OpenAIのフロンティアモデルとCodexエージェント、自動検証を組み合わせ、脆弱性の発見・検証・パッチ提案までを一貫して行うエージェント型ツールとして設計されています。

過去30日間のベータ期間において、外部リポジトリの120万件以上のコミットをスキャンし、792件のcritical(重大)および10,561件のhigh-severity(高深刻度)の問題を検出しました。重大な問題はスキャンされたコミットの0.1%未満にとどまっており、大量のコードを処理しつつノイズを抑制できることを示しています。

技術的な特徴

3段階のワークフロー

Codex Securityの最大の特徴は、スキャン前にプロジェクト固有の脅威モデルを構築する点です。従来の静的解析ツールはコードパターンの汎用的なマッチングに依存していましたが、Codex Securityはそこから一線を画すアプローチを取っています。

まず、リポジトリの構造を分析し、セキュリティ上重要なアーキテクチャを把握した上で、システムが何を信頼し、どこに最も露出しているかを記述した編集可能な脅威モデルを生成します。次に、構築した脅威モデルをコンテキストとして脆弱性を探索し、実世界での影響度に基づいて分類を行います。そして最終段階として、検出された問題をサンドボックス環境で検証し、動作するPoC(概念実証)の生成まで行うことで偽陽性をさらに削減します。最終的に、システムの挙動に整合するパッチ候補を提案します。

ベータ期間の精度改善

OpenAIによれば、ベータ期間中に精度は大幅に改善されました。ある事例ではノイズが初期から84%削減され、深刻度の過大報告率は90%以上低下、全リポジトリにわたる偽陽性率は50%以上改善されています。セキュリティチームが検出結果の重要度を調整すると、そのフィードバックが脅威モデルに反映され、以後のスキャン精度が改善される仕組みも備えています。

ただし、これらの精度指標はあくまでOpenAIの自己申告値であり、第三者機関による独立した検証を経たものではない点には留意が必要です。

内部運用での実績

OpenAI社内での初期運用では、実際のSSRF(Server-Side Request Forgery)脆弱性と、重大なクロステナント認証バイパスが発見され、いずれもセキュリティチームが数時間以内にパッチを適用しています。

OSSへの適用と14件のCVE

Codex Securityは、OpenAIが依存するオープンソースプロジェクトのスキャンにも使用されています。OpenSSH、GnuTLS、GOGS、Thorium、libssh、PHP、Chromiumなどの主要プロジェクトで脆弱性が発見され、14件のCVEが割り当てられました(うち2件は他の研究者との共同報告)。具体例としては、GnuTLSのヒープバッファオーバーフロー(CVE-2025-32990)やダブルフリー(CVE-2025-32988)、GOGSの2FAバイパス(CVE-2025-64175)や認証バイパス(CVE-2026-25242)などがあります。

あわせて、OSSメンテナ向けに「Codex for OSS」プログラムも始まっています。ChatGPT Pro/Plusアカウント、コードレビュー支援、Codex Securityへのアクセスを提供するもので、vLLMプロジェクトはすでに通常のワークフローにCodex Securityを統合して脆弱性の発見とパッチを行っています。

実務視点:Claude Code Securityとの比較と市場の現状

AnthropicとOpenAI、2週間差での相次ぐリリース

Codex Securityの公開は、Anthropicが2026年2月20日にClaude Code Securityを限定リサーチプレビューとして公開してから約2週間後のタイミングです。さらにAnthropicは3月6日にMozillaとの協働でFirefoxから22件のCVEを発見した成果を公表しており、AIコードセキュリティの分野で両社がほぼ同時期に動いています。

アプローチの違い

両ツールとも「AIがコードを推論し、パターンマッチングでは見つけられない脆弱性を検出する」という基本思想は共通していますが、公開情報から読み取れるアプローチの違いがあります。

Codex Securityは、プロジェクト固有の脅威モデルを最初に構築し、そのコンテキストの中で脆弱性を探索する「トップダウン」型です。サンドボックスでの自動検証とPoC生成を組み込み、偽陽性率の低減に注力しています。精度改善のメトリクス(ノイズ84%削減、偽陽性50%以上削減)を定量的に公開している点も特徴です。

一方、Claude Code Securityは、Anthropic Frontier Red Teamによる500件超の脆弱性発見研究で培ったアプローチをベースにしています。Anthropicの2月5日公式記事によれば、コミット履歴の分析や部分的に修正されたバグの変種追跡など、攻撃者視点で仮説を立てて脆弱性を探索する手法に強みがあります。Firefoxとの協働では、20分で最初のUse After Freeを発見するなど、速度面での実績を示しました。

共通する業界課題:OSSメンテナの負荷

両社が共通して言及しているのが、OSSメンテナの負荷問題です。OpenAIは公式ブログで、メンテナとの対話の中で「脆弱性レポートの不足が問題ではなく、低品質なレポートが多すぎることが問題だ」というフィードバックを受けたと明記しています。この認識はAnthropicのFirefox協働でも、再現可能なテストケースとパッチ候補の重要性として表れていました。curlプロジェクトのバグバウンティ廃止(2026年1月)とあわせて考えると、AIが脆弱性を発見する速度とメンテナのトリアージ能力の乖離という構造的な課題が浮き彫りになっています。

セキュリティチームにとっての実務的な意味

AIコードセキュリティツールは、従来の静的解析(SAST)を補完する位置付けにあります。SASTがルールベースで既知パターンを検知するのに対し、AI推論型はビジネスロジックの欠陥やアクセス制御の不備など、文脈依存の脆弱性に強みを持ちます。ただし、いずれも発展途上のリサーチプレビュー段階であり、精度メトリクスはベンダーの自己申告です。導入を検討する場合は、自社コードベースでの実地評価と、既存ツールとの併用が前提になります。

まとめ

OpenAIのCodex SecurityとAnthropicのClaude Code Securityが相次いで公開されたことで、AIによるコードセキュリティ分析は実験段階から、導入検証が現実的に進む段階へ入りつつあります。120万コミットから1万件超の高深刻度問題を検出し、14件のCVEに結びついたCodex Securityの実績は、AIが実用的なセキュリティツールとしてのポテンシャルを持つことを改めて示しています。同時に、精度の第三者検証、OSSメンテナへの負荷管理、既存ツールとの棲み分けといった課題は両社に共通しています。セキュリティチームにとっては、両ツールの特性を理解した上で、自社のワークフローに合った評価を始めるタイミングが来ているといえます。

参考情報

- OpenAI公式ブログ「Codex Security: now in research preview」(2026年3月6日)

Just a moment... - OpenAI公式ブログ「Introducing Aardvark: OpenAI’s agentic security researcher」(2025年10月、2026年3月6日更新)

Just a moment... - The Hacker News「OpenAI Codex Security Scanned 1.2 Million Commits and Found 10,561 High-Severity Issues」Ravie Lakshmanan(2026年3月7日)

![]() OpenAI Codex Security Scanned 1.2 Million Commits and Found 10,561 High-Severity IssuesOpenAI launches Codex Security AI agent that scanned 1.2M commits, finding 792 critical and 10,561 high-severity vulnera...

OpenAI Codex Security Scanned 1.2 Million Commits and Found 10,561 High-Severity IssuesOpenAI launches Codex Security AI agent that scanned 1.2M commits, finding 792 critical and 10,561 high-severity vulnera... - Anthropic公式ブログ「Claude Code Security」(2026年2月20日)

Making frontier cybersecurity capabilities available to defendersClaude Code Security is one step towards our goal of more secure codebases and a higher security baseline across the ind... - Anthropic公式ブログ「Partnering with Mozilla to improve Firefox’s security」(2026年3月6日)

Partnering with Mozilla to improve Firefox’s securityAnthropic is an AI safety and research company that's working to build reliable, interpretable, and steerable AI systems... - Anthropic Frontier Red Team「Zero-days」(2026年2月5日)

0-Days \ red.anthropic.com

コメント